Ars Technica

Jeudi, des chercheurs de Microsoft ont annoncé un nouveau modèle d’intelligence artificielle de synthèse vocale appelé Vallée Il peut imiter étroitement la voix d’une personne lorsqu’on lui donne un échantillon audio de trois secondes. Une fois qu’il a appris un son spécifique, VALL-E peut synthétiser le son de cette personne qui dit n’importe quoi – et le faire d’une manière qui tente de préserver le ton émotionnel de l’orateur.

Ses créateurs prévoient que VALL-E peut être utilisé pour des applications de synthèse vocale de haute qualité, l’édition de la parole où un enregistrement d’une personne peut être édité et modifié à partir d’une transcription de texte (lui faisant dire quelque chose qu’il n’a pas fait à l’origine), et la création de contenu audio lorsqu’il est combiné avec d’autres modèles d’IA tels que GPT-3.

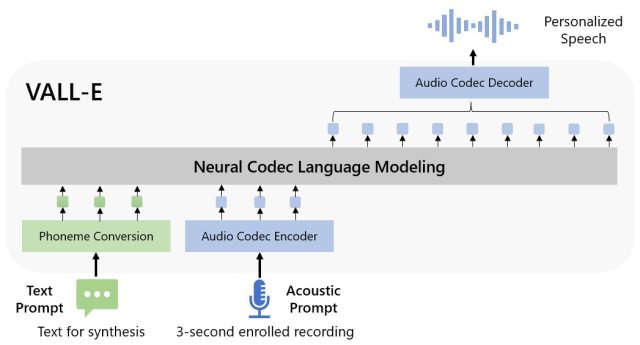

Microsoft appelle VALL-E un « paradigme de langage de codage neuronal », et il est basé sur une technologie appelée EnCodec, déclaré mort en octobre 2022. Contrairement à d’autres méthodes de synthèse vocale qui synthétisent généralement la parole en traitant des formes d’onde, VALL-E génère des encodeurs phonétiques séparés à partir d’invites textuelles et vocales. Il analyse essentiellement à quoi ressemble une personne, décompose cette information en composants séparés (appelés « codes ») grâce à EnCodec, et utilise les données de formation pour faire correspondre ce qu’il « sait » sur ce à quoi ressemblerait cette personne si elle parlait dans d’autres phrases en dehors de l’échantillon de trois secondes. Ou comme Microsoft le met dans un VALL-E PAPIER:

Pour le groupement vocal personnalisé (par exemple, non-shot TTS), VALL-E génère les codes vocaux correspondants modaux aux codes vocaux d’enregistrement de 3 secondes enregistrés et à l’invite vocale, qui contraignent respectivement les informations sur le locuteur et le contenu. Enfin, les codes audio générés sont utilisés pour regrouper la forme d’onde finale avec le décodeur neuronal correspondant.

Microsoft a formé les capacités de synthèse vocale de VALL-E dans une bibliothèque de sons, compilée par Meta, appelée Libre Lite. Il contient 60 000 heures d’anglais parlé par plus de 7 000 locuteurs, principalement tirés de LibriVox Livres audio du domaine public. Pour que VALL-E obtienne un bon score, le son de l’échantillon de trois secondes doit correspondre à un son des données d’entraînement.

sur vall-e Exemple de site WebMicrosoft fournit des dizaines d’exemples audio d’un modèle d’IA en action. Parmi les échantillons, une « invite de haut-parleur » est un son de trois secondes fourni pour VALL-E qui doit être imité. Une « vérité de terrain » est un enregistrement préexistant du même locuteur disant une déclaration particulière à des fins de comparaison (un peu comme un « contrôle » d’une expérience). « Baseline » est un exemple de synthèse fournie par la méthode de synthèse texte-parole traditionnelle, et l’échantillon « VALL-E » est produit à partir du modèle VALL-E.

Microsoft

Tout en utilisant VALL-E pour générer ces résultats, les chercheurs ont juste introduit un échantillon « Speaker Prompt » de trois secondes et une chaîne de texte (ce qu’ils voulaient que la voix dise) dans VALL-E. Comparez donc l’échantillon « Ground Truth » à l’échantillon « VALL-E ». Dans certains cas, les deux échantillons sont très proches l’un de l’autre. Certains des résultats VALL-E semblent être générés par ordinateur, mais d’autres sont susceptibles d’être confondus avec la parole humaine, ce qui est l’objectif du modèle.

En plus de préserver le timbre vocal et le ton émotionnel de l’orateur, VALL-E peut également simuler « l’environnement acoustique » d’un échantillon de voix. Par exemple, si l’échantillon provenait d’un appel téléphonique, la sortie audio simulerait les caractéristiques acoustiques et fréquentielles d’un appel téléphonique dans sa sortie synthétisée (c’est une façon élégante de dire que cela ressemblerait également à un appel téléphonique). et Microsoft échantillons (dans la section « Synthèse de la diversité ») ont montré que VALL-E peut générer des variations de hauteur en changeant les graines aléatoires utilisées dans le processus de génération.

Peut-être en raison de la capacité de VALL-E à alimenter les méfaits et la tromperie, Microsoft n’a pas fourni de code VALL-E pour que d’autres puissent l’essayer, nous n’avons donc pas pu tester les capacités de VALL-E. Les chercheurs semblent conscients des dommages sociaux potentiels que cette technologie pourrait causer. Pour conclure l’article, ils ont écrit:

« Étant donné que VALL-E peut synthétiser la parole qui préserve l’identité de l’orateur, il peut présenter des risques potentiels d’utilisation abusive du modèle, tels que l’usurpation de la reconnaissance vocale ou l’usurpation de l’identité d’un locuteur spécifique. Pour atténuer ces risques, il est possible de créer un modèle de détection pour discriminer si oui ou non un locuteur spécifique a été synthétisé. Bande sonore par VALL-E. Nous mettrons également Principes Microsoft de l’intelligence artificielle En pratique lors du développement de modèles.

« Amateur de musique. Joueur. Alcooliste. Lecteur professionnel. Spécialiste du Web. »